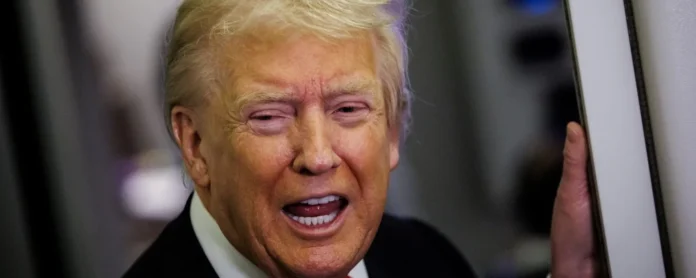

🧠 Apesar de uma ordem recente do presidente Donald Trump proibindo o uso de tecnologia da empresa de inteligência artificial Anthropic (que desenvolve o Claude), fontes jornalísticas afirmam que a ferramenta ainda foi empregada pelas Forças Armadas dos Estados Unidos em uma operação militar contra o Irã.

📌 O que aconteceu

Segundo relatórios do Wall Street Journal e outras publicações internacionais, o modelo de IA Claude foi usado por comandos militares — incluindo o Comando Central dos EUA (CENTCOM) no Oriente Médio — para apoiar a ofensiva contra o Irã mesmo após a proibição ter sido anunciada. A utilização teria acontecido apenas horas depois de Trump ordenar que todas as agências federais deixassem de usar produtos da Anthropic.

A ferramenta, que já estava integrada a sistemas militares, teria auxiliado em tarefas como:

- análises de inteligência,

- identificação de possíveis alvos,

- simulações de cenários de combate.

Esse uso mostra como sistemas de IA poderosa já estão muito conectados a operações complexas de defesa.

Siga o Jovem na Mídia nas redes sociais do Instagram, Facebook e Tiktok para não perder nada

🧠 Por que a proibição aconteceu?

A decisão de Trump veio devido a uma disputa com a Anthropic, que havia se recusado a permitir que o modelo fosse utilizado sem restrições pelo Pentágono — especialmente em casos como vigilância doméstica em massa ou uso autônomo de armamentos.

O governo classificou a empresa como um risco à “cadeia de suprimentos de segurança nacional” e estipulou um prazo de até seis meses para que o Departamento de Defesa deixasse de empregar a tecnologia, já que ela estava profundamente integrada em sistemas classificados.

🤖 O que isso mostra

Esses relatos colocam em destaque algumas questões sobre o uso de IAs avançadas em contextos militares:

- ferramentas de IA já são parte de sistemas de defesa complexos,

- banir ou remover rapidamente tecnologia profundamente integrada não é simples,

- existe um debate global sobre limites éticos e legais da IA em operações de guerra.

Enquanto isso, outras empresas de IA — como OpenAI — têm firmado acordos com o Departamento de Defesa para fornecer soluções com diferentes garantias de uso seguro.

💭 E você, acha que o uso de inteligência artificial em conflitos militares precisa ter regras mais claras? Compartilhe a sua opinião e marque alguém pra debater também!